Les femmes sont souvent discriminées lorsque l'IA est utilisée dans un processus décisionnel, notamment dans l'accès à l'embauche et au crédit.

— metamorworks

La Journée internationale des femmes, le 8 mars, est l’occasion de célébrer les avancées dans la lutte contre le sexisme et les inégalités de genre. Toutefois, la victoire est loin d’être acquise sur le plan des nouvelles technologies. L’intelligence artificielle (IA) crée même, en quelque sorte, de nouveaux biais de genre, comme l’explique Gaëlle Falcon, professeure à la Faculté des sciences de l’administration et directrice de l’Institut EDI2 (équité, diversité, inclusion, intersectionnalité).

Quels sont les biais de genre liés à l’IA et quels sont leurs effets?

Puisqu’elles se développent à partir de bases de données qui ne sont pas forcément représentatives de la place des femmes dans la société, les différentes IA discriminent de manière générale la population féminine. Par exemple, environ 80% des profils qu’on retrouve sur Wikipédia sont masculins. Ainsi, si une IA est entraînée à partir de ces données, elle aura tendance à en déduire que les personnes les plus remarquables sont majoritairement des hommes.

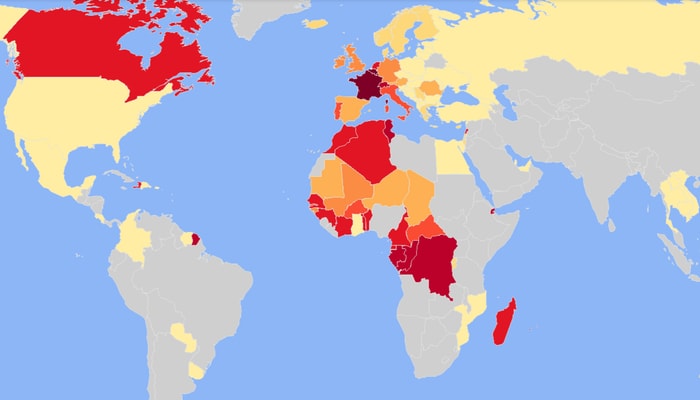

Les algorithmes tendent aussi à systématiser des biais. Par exemple, le revenu moyen des femmes est généralement inférieur à celui des hommes et il est considéré comme plus aléatoire parce que les femmes interrompent parfois leur carrière pour des raisons familiales. Les algorithmes qui donnent des recommandations pour un prêt personnel ou hypothécaire vont plus systématiquement moins bien noter les femmes ou donner une cote inférieure à leurs avoirs. Un exemple concret de cette situation a été révélé à la presse par Steve Wozniak, cofondateur d’Apple. Sa femme et lui avaient individuellement demandé la même carte de crédit et avaient obtenu des limites différentes, même s’ils avaient déclaré le même revenu familial.

Des paramètres qui vont systématiquement défavoriser les femmes se retrouvent potentiellement dans toutes les décisions où l’IA est appelée à donner une recommandation, peu importe le domaine. Par exemple, l’évaluation du risque peut être biaisée dans le domaine des assurances. Les femmes semblent aussi être discriminées dans l’accès à l’emploi, aux services de santé et au logement.

L’IA ne fait-elle que reproduire des biais de genre déjà présents ou en crée-t-elle de nouveaux?

À la base, ce n’est pas l’IA qui crée les biais. Ce sont plutôt les données qu’elle utilise ou les personnes qui ont conçu l’IA qui introduisent ces biais. Par contre, elle présente malheureusement un phénomène d’amplification. Et ce qui rend cette situation perverse, c’est que les décisions automatisées de l’IA ont une apparence d’objectivité et de neutralité.

Il y a une dizaine d’années, l’entreprise Amazon, qui reçoit un nombre considérable de CV, avait développé une IA pour faire la présélection des candidatures. L’algorithme avait été entraîné à partir des données de l'entreprise: les profils des personnes recrutées, ceux des personnes promues, ceux des personnes jugées les plus performantes, etc. Jamais personne n’a explicitement demandé à l’IA de discriminer les femmes. Pourtant, étant donné qu’historiquement, la majorité des personnes employées chez Amazon étaient des hommes et que la majorité des promotions et des hautes responsabilités étaient accordées à des hommes, l’IA a déduit par elle-même qu’un critère d’embauche et de promotion chez Amazon était d’être un homme. Ainsi, ce qui était une tendance potentiellement discriminatoire dans le recrutement est devenu quelque chose de systématiquement discriminatoire. Les analyses a posteriori ont montré que non seulement les candidatures des femmes étaient écartées par l’algorithme, mais également celles des hommes qui avaient étudié dans un programme féministe. Bref, l’IA amplifie les biais de genre et peut même aller jusqu’à les rendre systématiques, créant ainsi un biais additionnel en quelque sorte.

Gaëlle Falcon est professeure au Département de management. Elles est notamment une spécialiste de la gestion des ressources humaines et de la gestion de l'équité, de la diversité et de l'inclusion.

— Institut EDI2 (équité, diversité, inclusion, intersectionnalité)

Que peut-on faire pour atténuer ces biais?

La bonne nouvelle, c’est qu’il y a des solutions. Tout d’abord, il faut s’assurer que les bases de données sur lesquelles sont entraînées les IA soient plus représentatives de la société. Cela a un coût, mais c'est possible. Un collectif de femmes canadiennes, par exemple, s’est donné pour mission d’écrire des notices biographiques sur des personnalités féminines afin de pallier le manque de profils féminins sur Wikipédia.

Ensuite, il faut sensibiliser les personnes qui développent des IA aux risques de biais afin de prévenir les inégalités dès le début de la chaîne de conception. Lorsqu’un biais s’y incruste, il peut être extrêmement difficile de le faire disparaître. Par exemple, lorsqu’Amazon a été informée du biais involontaire dans le recrutement, l’entreprise a tenté de corriger le tir, mais n’a malheureusement pas réussi à inverser la tendance. Il faut également inciter le corps professoral qui forme les spécialistes de l’IA à intégrer dans leurs cours des notions d’éthique sur une IA dite responsable.

En outre, il faut que plus de femmes travaillent dans le développement des IA. Actuellement, elles ne représentent que 12% des chercheurs en IA selon l'UNESCO et aux alentours de 25% des personnes qui conçoivent des IA. Cette sous-représentation fragilise la prévention des biais de genre. Beaucoup d’efforts ont été faits pour encourager les filles à s’intéresser à ces métiers, mais les industries peinent à les attirer et surtout à retenir celles qu’elles embauchent. Il faut donc accentuer les efforts pour mieux les accueillir et leur offrir les mêmes possibilités de gestion de projets et de direction d’équipe que les hommes.

Finalement, il faut encourager une meilleure littératie de l’IA et conscientiser les citoyens et citoyennes ainsi que les organisations au fait que les algorithmes ne sont pas neutres. Il serait aussi particulièrement judicieux d’instaurer des règles pour obliger les organisations à dévoiler l’intervention d’une IA dans un processus décisionnel et à mettre en place une procédure de recours pour demander un réexamen du dossier par un être humain.

En terminant, je tiens à souligner le fait que le Québec, notamment grâce à son écosystème de recherche et industriel en IA, est mondialement très en avance dans la reconnaissance des différents biais et travaille fort à leur réduction. Nous pouvons nous en féliciter.

Propos recueillis par Manon Plante