La professeure Nadia Naffi

— Dany Vachon

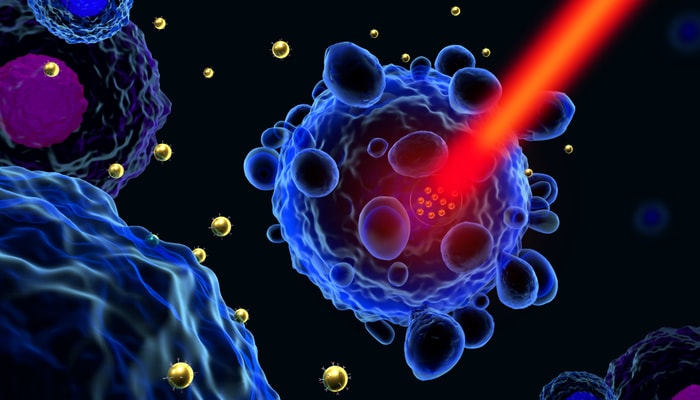

En trois heures, ils ont créé des hypertrucages, ou deepfakes en anglais. Générer de faux contenus, qui reprennent l'image ou la voix de personnes de façon hyperréaliste pour induire en erreur, est un jeu d'enfant à partir d'applications sur un téléphone cellulaire. Un groupe de jeunes adultes, qui ne se sentaient pas concernés par la lutte contre la désinformation par l'intelligence artificielle (IA), a changé d'attitude après cette expérience.

C'est ce qui ressort d'un projet de recherche mené par Nadia Naffi, professeure en sciences de l'éducation à l'Université Laval, et dont les résultats ont été publiés dans Journal of Constructivist Psychology. Elle et son équipe ont recruté 16 participants de 18 à 24 ans, de tous horizons, qui ont été soumis à des entrevues individuelles, à une série d'ateliers pratiques (dont la réalisation d'hypertrucages, mais sans diffusion) et à des discussions de groupe.

S'ils considéraient les deefakes comme inévitables et hors de leur contrôle en début d'exercice – «Je ne vais pas changer le monde», disaient certains –, leur discours a évolué en cours de route. «Tous ces ateliers m'ont montré à quel point c'est facile d'en créer et encore plus facile d'y croire», a lancé une participante. «Si cinq personnes sensibilisent cinq personnes et que ces personnes en sensibilisent cinq autres à leur tour, au bout de 13 ou quelque fois, une grande communauté est sensibilisée», a fait valoir un participant.

— Nadia Naffi

D'observateurs passifs, ces jeunes adultes sont devenus mobilisés et prêts à lutter contre ce fléau, a constaté la professeure Naffi. «C'est vraiment à partir de l'expérimentation de l'hypertrucage que le déclic se fait. Parler de la désinformation générée par l'IA, sensibiliser, ça ne suffit pas. Il faut le vivre pour comprendre comment ça peut nuire, comment des membres de notre famille peuvent tomber dans le piège», souligne celle qui est aussi titulaire de la Chaire de leadership en enseignement sur les pratiques pédagogiques innovantes en contexte numérique – Banque Nationale.

À la lumière des résultats du projet de recherche et à travers les recommandations des participants, elle exhorte les décideurs et les établissements d'enseignement à intégrer ce type de formation de quelques heures, sous forme d'apprentissage expérientiel. «Il faut une éducation ciblée sur les deepfakes pour créer une génération de citoyens numériques conscientisés, pour développer leurs compétences à évaluer la validité des informations en ligne et pour qu'eux-mêmes puissent alerter leur entourage.»

Alors que les systèmes judiciaires et les gouvernements ont du mal à suivre la progression effrénée de ces dérives numériques, la contribution humaine par l'éducation doit faire partie de la solution, estime Nadia Naffi.

Une menace mondiale

Le recours aux hypertrucages est une grave menace pour la société, poursuit la professeure, en citant le Rapport sur les risques globaux 2024 du Forum économique mondial, qui en fait mention.

«J'ai vécu la guerre à cause de ça, ce n'est pas peu!», ajoute-t-elle à titre plus personnel. Libanaise d'origine, elle explique avoir vécu plusieurs guerres, alimentées par de l'information manipulée. «On avait des chaînes de télévision spécifiques à chaque groupe politique. Je m'assurais de toutes les écouter pour avoir une image plus complète.»

Elle s'inquiète aujourd'hui pour l'intégrité des élections partout dans le monde, alors que les campagnes de désinformation grondent et que la population n'est pas «équipée» contre la manipulation. L'actualité récente donne des exemples d'hypertrucage, comme ces électeurs qui ont reçu un appel automatisé imitant la voix de Joe Biden les encourageant à ne pas voter lors des primaires du New Hampshire. «Conservez votre vote pour les élections de novembre», indiquait la voix truquée du président américain.

Les jeunes sont souvent considérés par la société comme une génération influençable, constamment branchée sur les médias sociaux, remarque la professeure. Mais son projet de recherche montre le contraire: «Ils sont critiques, ils ne sont pas faciles à manipuler. Ils ont juste besoin d'être valorisés et accompagnés pour prendre leur place. S'ils sont informés, exposés à des cas qui leur parlent, amenés à expérimenter et à réfléchir ensemble, ils comprennent que leurs actions peuvent faire une différence.»

Nadia Naffi compte poursuivre ses travaux de recherche, cette fois avec des personnes âgées, «victimes au quotidien» de l'hypertrucage et de la désinformation par l'IA.

Les autres signataires du projet de recherche paru dans Journal of Constructivist Psychology sont Mélodie Charest, Sarah Danis, Laurie Pique, Nicolas Brault, Marie-Claude Bernard et Sylvie Barma, de l'Université Laval, ainsi que Ann-Louise Davidson, de l'Université Concordia.